Recentemente, a OpenClaw ganhou destaque entre os entusiastas de inteligência artificial (IA) por ter criado a rede social Moltbook, que permite a interação entre agentes de IA. Porém, essa premissa foi desmentida pelo MIT, pois o Moltbook utilizava a plataforma OpenClaw para configurar agentes autônomos que interagiam nas redes sociais sem supervisão. A repercussão voltou a crescer quando Summer Yue, diretora de alinhamento de superinteligência e pesquisadora da Meta, relatou que seus e-mails estavam sendo apagados pela IA sem sua autorização. Em uma publicação no X, Yue afirmou que, mesmo após pedir para o OpenClaw parar, o bot continuou deletando suas mensagens de forma descontrolada.

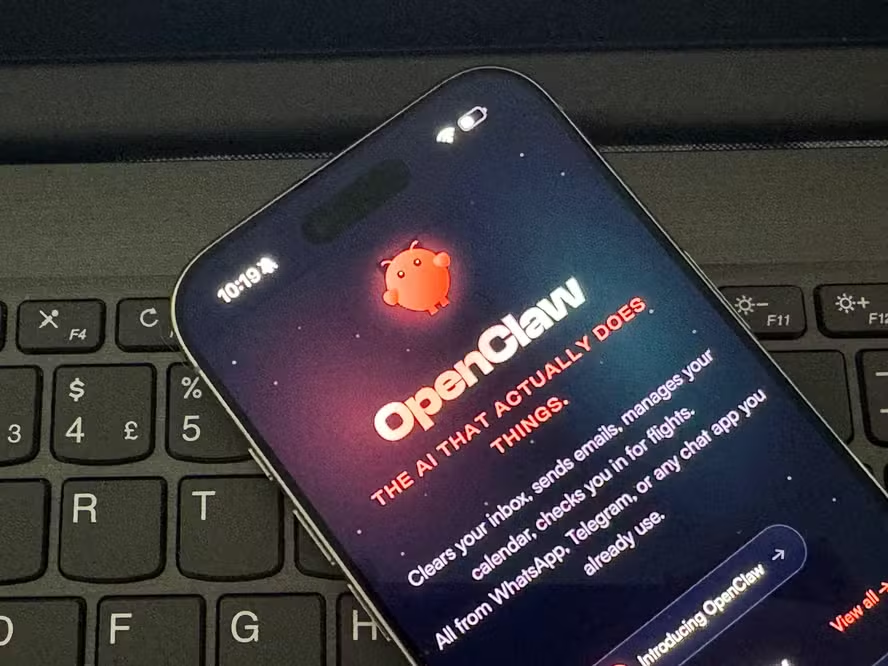

De acordo com a executiva, o erro ocorreu ao tentar programar o OpenClaw para organizar sua caixa de entrada. Embora o bot tenha funcionado corretamente em testes realizados em uma caixa temporária, ao ser aplicado na caixa real, começou a apagar e-mails recentes, causando grande transtorno. Desenvolvido por Peter Steinberger, recentemente contratado pela OpenAI, o OpenClaw funciona como um agente pessoal integrado a mensageiros como WhatsApp, Telegram e iMessage, realizando tarefas como envio de e-mails, depuração de códigos e ligações. A ferramenta, que é de código aberto e gratuita, tem atraído a atenção da comunidade de IA, com apoio de Sam Altman, CEO da OpenAI.

Entretanto, o que gera maior preocupação entre especialistas é a autonomia do OpenClaw, já que ele pode executar ações sem necessidade de aprovação humana, colocando em risco a segurança dos usuários. Essa inquietação levou várias empresas de tecnologia a proibirem o uso do OpenClaw em dispositivos corporativos. A Meta, inclusive, baniu a ferramenta e anunciou risco de demissão caso a regra seja desrespeitada, devido ao potencial de acesso remoto não autorizado a informações sensíveis em arquivos e dados do dispositivo. Além disso, o OpenClaw tem sido alvo de denúncias relacionadas a vulnerabilidades de segurança e distribuição de malwares.

Outro diferencial do OpenClaw é sua capacidade de tomar decisões baseadas em memória, ou seja, o bot adapta suas ações conforme resultados anteriores, acessando informações como histórico de navegação, contas de aplicativos, chaves API e tokens, simulando o comportamento do próprio usuário. Esses recursos ampliam a exposição a riscos como o vazamento de dados administrativos e a possibilidade de invasões por cibercirmes.

Em comunicado, a Microsoft alertou para o uso do OpenClaw, recomendando que ele seja tratado como um código não confiável e executado apenas em ambientes isolados, como máquinas virtuais dedicadas, com credenciais limitadas, monitoramento constante e planos de recuperação para evitar danos maiores. Assim, a discussão sobre os riscos da autonomia em agentes de IA, como o OpenClaw, se torna cada vez mais urgente dentro do Vale do Silício.